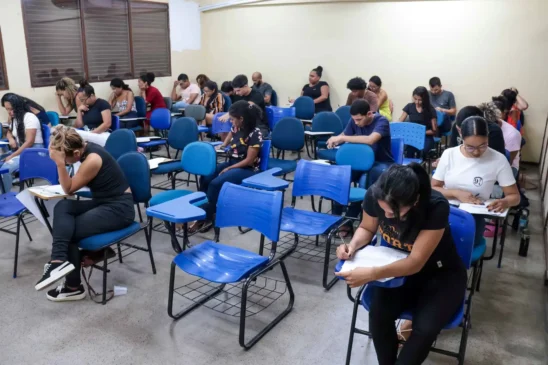

Um episódio ocorrido na Flórida, nos Estados Unidos, acendeu o alerta sobre o uso da inteligência artificial entre jovens. Um aluno de 13 anos foi detido após usar o ChatGPT para perguntar “como matar meu amigo no meio da aula?”. A mensagem, feita em tom que o próprio garoto afirmou ser “brincadeira”, ativou um sistema de monitoramento chamado Gaggle, usado por escolas americanas para detectar comportamentos suspeitos em tempo real. A plataforma enviou um alerta à polícia escolar, que deteve o estudante imediatamente.

De acordo com as autoridades locais, o menino acessou o chatbot em um laptop fornecido pela escola durante o horário de aula. Ao ser questionado, ele disse que não tinha intenção de ferir ninguém e que apagou a mensagem logo em seguida. Mesmo assim, a direção e a polícia do condado de Volusia optaram por levá-lo ao centro de custódia juvenil, onde aguarda decisão judicial. O caso é tratado com seriedade, especialmente diante do histórico de ataques em instituições de ensino americanas, como o massacre de Parkland, também na Flórida, em 2018.

O Dilema da Segurança e Privacidade nas Escolas Digitais

O episódio expõe um dilema crescente: como equilibrar segurança e privacidade no ambiente escolar digital. O Gaggle, adotado por mais de 1.500 distritos nos EUA, utiliza inteligência artificial para identificar sinais de depressão, cyberbullying ou violência, permitindo intervenções rápidas. Educadores defendem sua eficácia, mas críticos alertam para o risco de criminalizar comportamentos imaturos. O caso do jovem na Flórida, que mistura tecnologia, vigilância e responsabilidade, reforça a importância de educar crianças e adolescentes para o uso ético e consciente das novas ferramentas digitais.